La confiance inversée

La confiance en entreprise bascule des managers vers les algorithmes : décryptage d'une inversion qui redéfinit le management, la communication et la sécurité psychologique au travail.

January 6, 2026

En 2017, Rachel Botsman publiait Who Can You Trust?, probablement un des ouvrages que j’ai le plus offerts à l’époque. Elle annonçait l'avènement de la «confiance distribuée», une nouvelle ère où, paradoxalement, nous faisons davantage confiance à des inconnus via une plateforme numérique (Uber, Airbnb…) qu'aux institutions traditionnelles. Sa thèse centrale était limpide : nous ne vivons pas une crise de confiance, mais sa transformation radicale.

Huit ans plus tard, cette intuition se vérifie avec une précision troublante et prend une dimension nouvelle. Car le «saut de confiance» (trust leap) décrit par Botsman ne s'opère plus seulement vers des plateformes ou des pairs inconnus. Il s'opère désormais vers les algorithmes eux-mêmes. Et si demain, notre meilleur confident au travail n'était plus notre collègue préféré ni notre DRH, mais une intelligence artificielle ?

Les données de 2024-2025 révèlent une accélération spectaculaire de ce basculement au cœur même des organisations. Là où Botsman observait que «la confiance est une relation confiante avec l'inconnu», nous assistons à l'émergence d'une nouvelle forme : une relation confiante avec l'algorithme. Une évolution qui ouvre autant d'opportunités qu'elle pose de questions, et qui mérite en tout cas d'être explorée avec sérieux.

L'inversion de la pyramide de confiance

Pendant des décennies, nous avons bâti nos organisations sur une conviction : le manager humain reste le dépositaire ultime de la confiance, de l'empathie et du jugement nuancé. Le «capitaine» vers qui l'on se tourne quand les choses se compliquent.

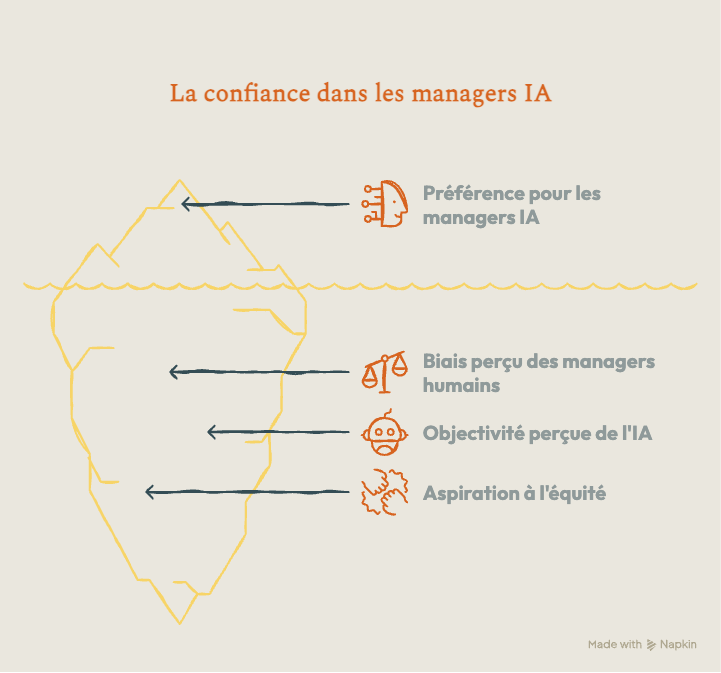

Or, les données récentes nous invitent à repenser cette certitude. Selon une enquête publiée par HR Dive, 38 % des travailleurs préféreraient aujourd'hui avoir un manager IA plutôt qu'une personne physique.¹ Ce chiffre, loin d'être anecdotique, traduit une désillusion vis-à-vis des biais et de l'imprévisibilité perçus du management humain.

Plus surprenant encore : cette tendance s'observe aussi au sommet. La moitié des dirigeants (C-suite) déclarent préférer des managers IA, bien qu'un tiers admette ne pas toujours distinguer l'IA de l'humain.¹ Nous assistons donc à une forme de «démocratisation» de cette confiance algorithmique, qui transcende les niveaux hiérarchiques.

Le facteur d'objectivité perçue

D'où vient ce basculement ? Les travaux de l'Université du New Hampshire apportent un éclairage précieux.² Lorsque les employés anticipent un biais ou un traitement injuste de la part de leur superviseur : favoritisme, désapprobation personnelle, préjugés inconscients, ils accueillent favorablement l'implication de l'IA dans leurs évaluations de performance.

L'algorithme devient alors un «témoin impartial» (Fair Witness). Contrairement au manager humain, dont le jugement peut être obscurci par la fatigue, l'humeur ou les affinités personnelles, l'IA est perçue comme régie par des règles cohérentes. Comme le souligne Yunshil Cha, professeure à l'UNH, cette préférence découle directement de la «perception d'objectivité» de l'IA.²

Pour les entreprises : cette recherche d'objectivité n'est pas un rejet de l'humain, mais une aspiration à l'équité. Les organisations qui sauront combiner l'intelligence émotionnelle du manager avec la rigueur de l'algorithme créeront un nouveau standard de confiance.

L'effet de désinhibition bénigne : la «confidence numérique»

Au-delà de l'évaluation, cette confiance en la machine transforme la dynamique de la communication interpersonnelle. Nous assistons à l'institutionnalisation de ce que les chercheurs appellent l' «effet de désinhibition en ligne» mais sous une forme nouvelle et productive.⁶

La machine comme confessionnal organisationnel

Les entreprises découvrent un phénomène fascinant : les agents conversationnels IA deviennent les dépositaires des vérités cachées de l'organisation. L'analyse des conversations avec les IA révèle des risques psychosociaux bien avant qu'ils ne remontent par les canaux traditionnels.⁶ Les employés y cherchent du soutien sans craindre le jugement social, la stigmatisation ou les représailles.

Comparaison des dynamiques de communication

Aspect Humain-Humain Humain-IA

Jugement perçu Élevé (peur du regard) Faible (neutralité perçue)

Dévoilement de soi Filtré, prudent Authentique, direct

Disponibilité Limitée, variable 24/7, constante

Risque politique Élevé (rumeurs, carrière) Faible (si anonymisation)

Paradoxalement, les recherches montrent que l'interaction avec des chatbots «humanisés» encourage encore davantage la divulgation d'informations sensibles.⁸ C'est l'illusion d'humanité combinée à la sécurité de la machine qui crée ce réceptacle idéal pour les préoccupations des collaborateurs.

Pour les RH : si l'IA devient le premier confident, comment repositionner le «HR Business Partner» ? Non pas comme concurrent de la machine, mais comme orchestrateur des insights qu'elle révèle ?

Le paradoxe de la transparence

Voici où les choses se compliquent et deviennent passionnantes pour les dirigeants. Si les employés font confiance à l'IA en tant qu'entité, ils se méfient profondément des humains qui utilisent l'IA pour communiquer avec eux.⁹

Une série de 13 expériences impliquant plus de 5 000 participants a démontré que révéler l'utilisation de l'IA pour rédiger des messages ou prendre des décisions mine considérablement la confiance accordée à l'utilisateur.⁹ L'honnêteté quant à l'usage de l'IA, loin d'être récompensée, est perçue comme un manque de compétence ou d'authenticité.

La double contrainte du manager augmenté

Cette situation crée un dilemme délicat :

- Utiliser l'IA en secret expose au risque d'un scandale si la vérité émerge (« la dissimulation étant pire que le crime »)

- Être transparent sur l'usage de l'IA peut être perçu comme paresseux ou émotionnellement distant

La voie médiane : le manager de demain devra naviguer sur une ligne de crête : utiliser l'IA pour l'augmentation cognitive sans devenir une simple «interface pour l'algorithme». Le narratif doit évoluer : non pas «l'IA fait mon travail», mais «l'IA m'aide à être plus juste et plus attentif». On revient à l’augmentation par l’IA maintes fois évoquée dans nos articles.

Redéfinir la sécurité psychologique pour 2026

L'American Psychological Association note que 92 % des psychologues expriment des inquiétudes sur l'IA, notamment en matière de sécurité des données et de biais.¹⁰ Ces préoccupations sont légitimes et doivent guider notre approche.

Cependant, dans l'entreprise, nous observons une redéfinition progressive de la «sécurité psychologique». Historiquement, elle se mesurait à la capacité de parler à son chef sans crainte. Demain, elle pourrait inclure la capacité d'interagir avec un système qui ne juge pas, à nouveau une extension/augmentation plutôt qu'un remplacement.

Trois leviers d'action pour les dirigeants

Face à cette transformation, voici les pistes que nous explorons avec nos clients :

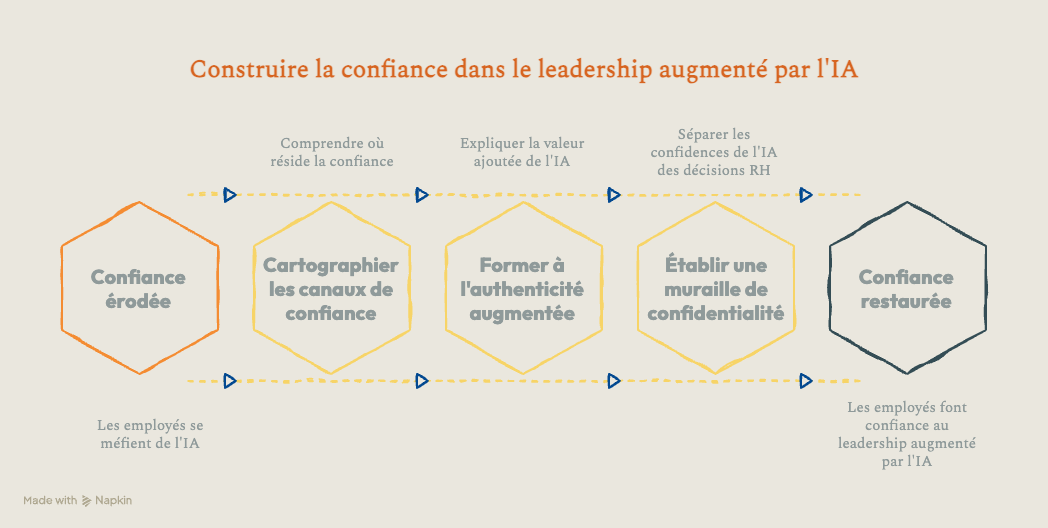

Cartographier les canaux de confiance

Où réside la confiance réelle dans votre organisation ? Si les employés parlent aux bots et filtrent leurs échanges avec les managers, vos systèmes de feedback méritent d'être repensés. L'IA peut devenir un canal officiel de «voix de l'employé» à condition d'être conçue comme tel.

Former à l'authenticité augmentée

L'enjeu n'est pas de cacher l'IA, mais d'expliquer comment elle rend les managers plus équitables. La transparence devient une force quand elle est accompagnée d'un récit clair sur la valeur ajoutée humaine : «L'IA me donne les données pour être un meilleur leader, pas pour me remplacer.»

Établir une muraille de confidentialité

Pour maintenir la confiance dans le «manager algorithmique», une séparation stricte doit exister entre les confidences faites à l'IA d'assistance et les données utilisées pour les décisions RH.¹¹ Cette garantie n'est pas optionnelle, elle est le socle du système.

En guise d'ouverture

La confiance inversée n'est ni une menace ni une panacée, c'est un signal. Elle nous dit que nos collaborateurs aspirent à plus d'équité, plus de disponibilité, moins de politique dans leurs évaluations. L'IA, bien déployée, peut répondre à ces aspirations.

Mais elle ne remplacera jamais ce qui fait la richesse du travail humain : la créativité, l'intuition contextuelle, la capacité à inspirer. L'enjeu pour 2026 et au-delà sera de créer des organisations où l'humain et l'algorithme se renforcent mutuellement, pas de choisir l'un contre l'autre.

C'est précisément cette hybridation que nous accompagnons chez Spentia : diagnostiquer les points de friction organisationnels en combinant la puissance analytique de l'IA avec l'intelligence humaine des consultants seniors. Parce que la transformation n'est pas une question de technologie, c'est une question de confiance.

Rejoignez la conversation

Le signal Spentia : des insights actionnables à la croisée de l'IA, de la transformation et des talents.

À chaque édition : le point sur ce qui bouge dans la transformation des organisations ; outils, méthodes, retours d'expérience et enjeux humains.