l'ia et l'innovation

Comment l'IA générative menace l'innovation par l'homogénéisation de la pensée, et pourquoi la singularité organisationnelle est le vrai levier de différenciation à l'ère algorithmique.

February 11, 2026

Sommes-nous en train d'innover ou de simplement « moyenner » le monde ?

Depuis l'apparition de ChatGPT fin 2022, le narratif dominant n’a cessé de confondre deux notions pourtant distinctes : la productivité et l’innovation. La première est une affaire de vitesse : on sait aujourd’hui que les développeurs vont 55,8 % plus vite avec des assistants IA. La seconde est une affaire de différence.

Pourtant, malgré des outils de plus en plus puissants, nos productions n’ont jamais semblé aussi… interchangeables. Ma question : sommes-nous face à un catalyseur de rupture ou à une machine à homogénéiser la pensée ?

Le paradoxe du prisme : pourquoi l’IA n’aime pas l’originalité

Le fonctionnement même des modèles de langage repose sur ce que le chercheur Bijean Ghafouri nomme une « épistémologie dérivée ». En clair : ces modèles sont conçus statistiquement pour prédire le mot suivant le plus probable. Ils agissent comme un prisme centralisé qui réduit la variance pour converger vers la moyenne.

Ce n’est pas un défaut mineur. C’est une propriété structurelle qui entre en collision frontale avec le mécanisme même de l’innovation :

La réduction de la variance

L’innovation radicale naît des anomalies, des signaux faibles, des déviations. Ghafouri définit la « variance informationnelle », l’éventail des perspectives, styles et cadres conceptuels disponibles, comme un capital épistémique crucial. Un système à haute variance contient davantage de « blocs de construction » informationnels distincts, augmentant sa capacité à générer des solutions inattendues. En moyennant ces variations, l’IA détruit précisément ce capital. Résultat : des « monocultures génératives » où les idées, les solutions et les propositions finissent par se ressembler.

La plausibilité contre la vérité

Les modèles remplacent la découverte par la plausibilité statistique. On ne cherche plus ce qui est vrai ou neuf, mais ce qui « sonne » juste. Ce glissement est insidieux : à force de déléguer notre travail cognitif aux machines, nous risquons ce que Bernard Stiegler appelait une « prolétarisation » de l’esprit, où l’on valide des sorties statistiques sans en comprendre les ressorts.

L’effondrement des connaissances

Enfin, le chercheur Andrew J. Peterson formalise ce risque sous le terme de knowledge collapse. Son modèle est saisissant : une simple réduction de 20 % du coût d’accès à l’information via l’IA peut éloigner les croyances publiques de la vérité d’un facteur 2,3. Quand l’accessibilité remplace l’exploration, la base même sur laquelle l’innovation s’appuie s’érode.

L’autophagie algorithmique : quand l’IA mange sa propre queue

Nous atteignons en 2026 un point de bascule critique : le Model Collapse, ou trouble d’autophagie des modèles. Les chercheurs de l’Inria le comparent à « un processus de photocopie infinie où chaque nouvelle copie perd un peu plus de la richesse de l’original ». On estime aujourd’hui que 30 à 40 % du texte actif sur le web est généré par IA.

Lorsque les modèles sont entraînés sur les données synthétiques de leurs prédécesseurs, ils entrent dans une spirale dégénérative : ils oublient les signaux faibles de distribution, les nuances, les cas rares, et produisent des contenus de plus en plus homogènes et biaisés, et l’innovation stagne parce que le système sature de ses propres créations.

Kate Crawford parle de « rupture métabolique ». L’internet devient un « zombie » où le contenu généré ne veut plus rien dire, servant uniquement de carburant stérile pour la prochaine itération d’IA. Et le phénomène se vérifie sur le terrain : en France, le Livre Blanc du CEMU de l’Université de Caen alerte sur l’uniformisation des productions étudiantes ; les graphistes constatent l’émergence d’une esthétique « IA-style » reconnaissable ; les chercheurs du réseau Circé observent une standardisation des formats scientifiques. Dans les entreprises, l’IA tire les produits vers un « modèle partagé » où chacun adopte l’outil pour ses propres gains, ignorant l’érosion collective de la différenciation.

Le « compost numérique » : une lueur d’espoir pour l’innovation

Tout n’est pas noir. Un paradoxe dialectique émerge, et il change la donne pour quiconque s’intéresse à l’innovation de rupture.

Ghafouri avance une thèse aussi stimulante que contre-intuitive : l’homogénéisation qui aplatit les connaissances au sein des domaines spécialisés les rend simultanément modulaires. En convertissant des concepts complexes en fragments cohérents et standardisés, l’IA facilite leur recombinaison à travers différents domaines, or c’est précisément cette recombinaison inter-domaines qui est le moteur historique de l’innovation radicale, de la pénicilline aux semi-conducteurs.

L’IA agirait comme un compost numérique. Elle décompose la culture passée en fragments. Si nous nous contentons de consommer ce compost, nous obtenons une monoculture infertile. Mais si nous agissons comme des curateurs actifs, nous pouvons utiliser ces modules pour créer des recombinaisons inédites, à condition que quelqu’un soit là pour cultiver ce terreau.

Comment passer de la substitution à la complémentarité ?

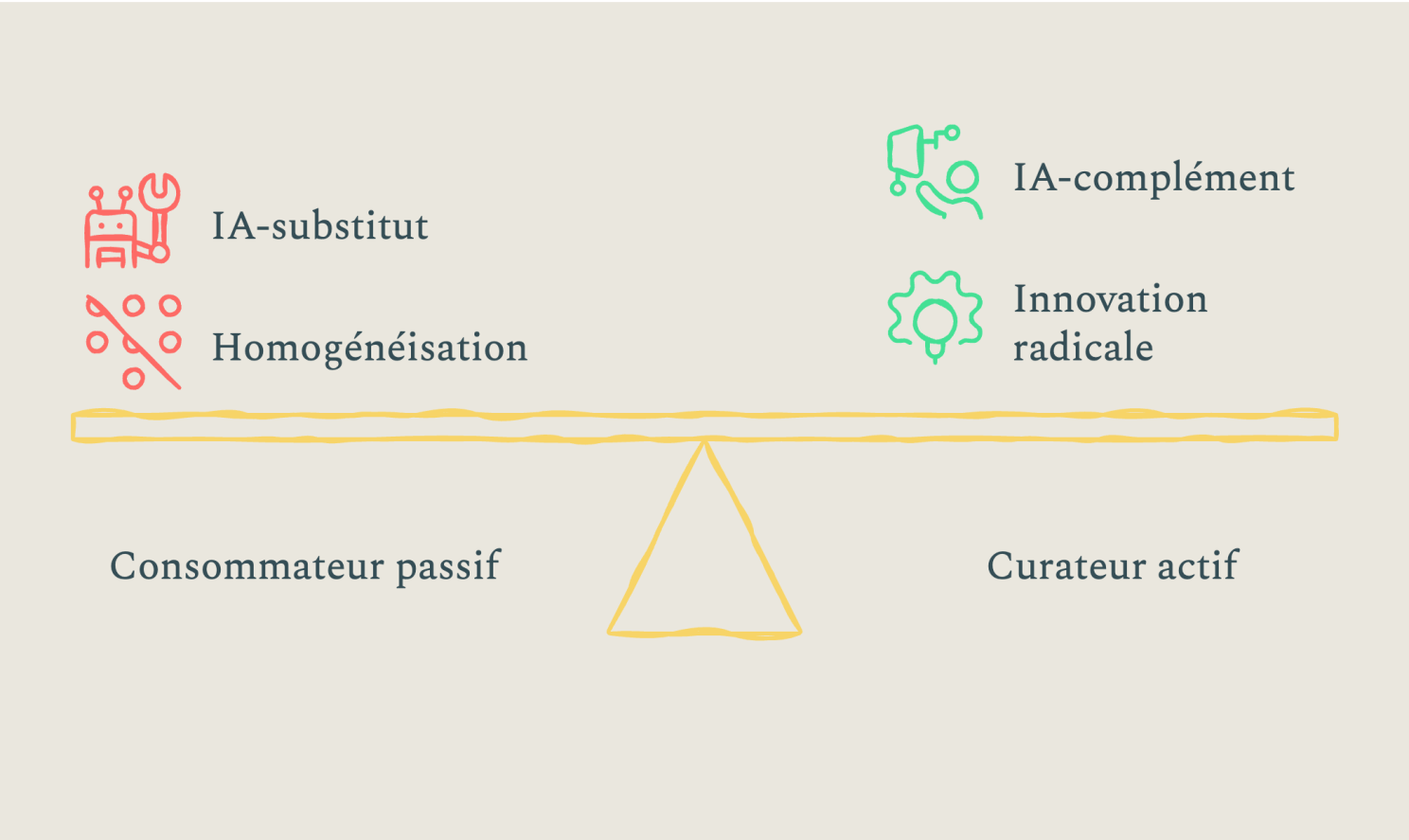

La recherche de Zhong et al. (2026) modélise deux postures face à l’IA et leurs conséquences à long terme sur l’innovation :

Le constat est sans appel : si la sélection individuelle favorise l’IA-substitut (plus efficace à court terme), seule l’IA-complément maintient la variance nécessaire à l’exploration et à l’innovation à long terme. L’innovation authentique est un processus néguentropique : c’est la capacité à créer de la différence dans un système qui tend vers l’uniformité. L’IA peut aider à explorer, mais seul l’humain peut décider de la « bifurcation » qui fera sens.

Les données françaises illustrent ce décalage. 94 % des industriels investissent dans l’IA, mais seulement 2 % estiment qu’elle a généré le meilleur retour sur investissement en 2024. Ce gouffre ne révèle pas un problème d’outil, il révèle un angle mort organisationnel : la plupart des entreprises déploient l’IA en mode substitut sans avoir cartographié les conditions humaines qui permettent à l’innovation d’émerger.

C’est précisément cet angle mort qui nous a conduits à fonder Spentia. Notre conviction : l’innovation par l’IA ne peut émerger que si elle part de la réalité terrain, les frictions silencieuses, les savoirs enfouis, les signaux faibles que personne n’a le temps d’écouter et qui sont pourtant la matière première de la différenciation. Notre agent conversationnel donne la parole à l’ensemble des collaborateurs, en toute confidentialité, pour cartographier cette réalité en quelques jours. Ce n’est pas un sondage de plus : c’est une écoute systémique, sans biais hiérarchique, qui alimente un plan d’action concret. Pas de modèle préconçu, pas de consultant hors sol, parce que le vrai levier de l’innovation par l’IA, ce n’est pas l’algorithme, c’est la singularité de l’organisation qui l’accueille.

Vers la technodiversité : un impératif stratégique et culturel

Pour sauver l’innovation, nous devons briser la « monoculture algorithmique ». Le philosophe Yuk Hui, prolongeant les travaux de Bernard Stiegler, nous invite à penser la technodiversité : refuser une technologie universelle et monolithique qui imposerait une rationalité unique. Différentes cultures, différentes organisations, différents métiers ont besoin de relations différentes avec la technologie. L’UNESCO elle-même en fait désormais un axe central de sa politique culturelle.

Pour les dirigeants qui veulent innover sans uniformiser, trois leviers émergent de la recherche récente :

Favoriser la diversité épistémique. Utiliser des écosystèmes de modèles divers plutôt qu’un seul outil dominant. La recherche de Hodel et West le démontre : la diversité entre les modèles atténue l’effondrement des connaissances. Mais attention, cette diversité doit être optimisée : trop peu mène à un effondrement rapide, trop de fragmentation réduit la capacité de chaque modèle.

Soutenir les communs numériques. S’inspirer de modèles comme Wikipédia ou arXiv pour favoriser la contribution plutôt que la consommation passive. Comme le montre Miguel Vanvlasselaer à partir des travaux d’Elinor Ostrom, une économie du commun numérique est possible, à condition de mobiliser les techniques dans un cadre collaboratif qui ne produit pas la prolétarisation massive des plateformes dérégulées.

Maintenir l’agence humaine au cœur du dispositif. L’IA est un pharmakon : remède et poison à la fois. Écouter avant d’automatiser. Cartographier ce qui différencie avant de déployer ce qui standardise. Résister à la tentation du modèle unique et cultiver la pluralité des approches au sein de l’organisation.

L’innovation est un choix, pas un algorithme

En 2026, l’IA nous place face à un miroir. Si nous l’utilisons pour nous faciliter la tâche, nous obtiendrons un monde lisse, prévisible et stérile. Si nous l’utilisons pour bousculer nos propres biais et recombiner nos savoirs, elle deviendra le terreau d’une nouvelle innovation.

L’avenir de l’innovation n’appartient pas aux organisations qui adoptent l’IA le plus vite, mais à celles qui savent préserver ce que l’IA ne peut pas produire : la singularité de la pensée humaine, ancrée dans un contexte, une culture, une histoire.

Rejoignez la conversation

Le signal Spentia : des insights actionnables à la croisée de l'IA, de la transformation et des talents.

À chaque édition : le point sur ce qui bouge dans la transformation des organisations ; outils, méthodes, retours d'expérience et enjeux humains.